Läste tidningen "Modern psykologi" genom Readly

Under semestern när jag var på Facebook så fick jag återkommande reklam för Readly, en prenumerationstjänst för olika typer av tidningar (7000+ magasin och dagstidningar skriver de på hemsidan). Till slut tänkte jag att det var värt att testa en gratismånad för att se vad det är. Har inte gjort nån riktig utvärdering av vad jag tycker än, men skulle jag redan vara prenumerant på nån av tidningarna så verkar utbudet man får för 119:- månaden som ett kap! Serietidningarna var dock svårlästa på mobilen, det blir för smått...

Hur som helst, i tidningen "Modern psykologi" (det kombinerade sommarnumret 4 och 5, 2023) så hade de en artikel av Sara Hammarkrantz om "Intellektuell ödmjukhet", vilket var ett nytt begrepp för mig, som jag tyckte var intressant. Hon skriver bland annat:

Att vara intellektuellt ödmjuk handlar om att vara öppen för nya perspektiv, idéer och information från andra - och att vara villig att ompröva sina egna åsikter och tankar.

Mark Learys, forskare och professor i psykologi och neurovetenskap vid Duke University definierar det som:

I vilken utsträckning människor kan erkänna att deras övertygelser kan vara fel.

Vad kan hända då, om den intellektuella ödmjukheten hos befolkningen är låg? Fredrik Livheim, psykolog och forskare i klinisk neurovetenskap säger:

Vi behöver växla upp vår förmåga globalt att hantera komplexitet och många perspektiv. Annars kommer fler och fler att ta till coping-strategier i form av förenklade världsbilder, svart-vitt tänkande och polarisering. Vi kommer se mer av Trumpism, konflikter och att folk söker sig till starka-ledare-med-enkla-sanningar.

Bias

Artikeln nämner att en sak som ställer till det för oss när vi tänker är olika typer av bias, bland annat nämner de Overconfidence bias (the tendency to overestimate our knowledge and abilities in a certain area). I samband med det tar de upp ett exempel om en studie som gjordes på larmcentralen 112 där man tagit hjälp av AI för att hitta orsaken till varför operatörerna och de inringande ibland missade att den drabbade personen fått hjärtstillestånd. När en larmfunktion utifrån detta skapades och installerades så ignorerade personalen ändå varningarna från larmet eftersom de tyckte att de själva var bättre på att avgöra den drabbades tillstånd. Tyvärr gavs ingen referens till studien och jag har inte lyckats hitta någon information om den annat än innan den genomfördes "Snart införs AI-stöd för medicinska vårdbedömningar på 112".

Det här fick mig att tänka på en lista med 50😱olika typer av bias som jag sett swisha förbi i mitt flöde förut. Ett sätt att bli mindre biased är att lära sig om olika bias och reflektera över om man fallit i någon av tankefällorna. 50 stycken känns som många att hålla reda på, men jag tänkte att det här inlägget ska hjälpa mig att sätta mig in i några i taget.

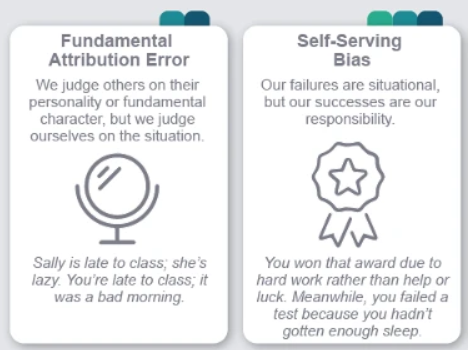

På sidan titlemax.com kan du hitta nedanstående lista i text, men de har också en bildversion av samma lista där varje bias har ett förtydligande exempel, vilket jag tycker gör rätt mycket för förståelsen.

|

| Två exempel på bilder av bias med förtydligande exempel |

50 Types of Common Cognitive Biases

- Fundamental Attribution Error: We judge others on their personality or fundamental character, but we judge ourselves on the situation.

- Self-Serving Bias: Our failures are situational, but our successes are our responsibility.

- In-Group Favoritism: We favor people who are in our in-group as opposed to an out-group.

- Bandwagon Effect: Ideas, fads, and beliefs grow as more people adopt them.

- Groupthink: Due to a desire for conformity and harmony in the group, we make irrational decisions, often to minimize conflict.

- Halo Effect: If you see a person as having a positive trait, that positive impression will spill over into their other traits. (This also works for negative traits.)

- Moral Luck: Better moral standing happens due to a positive outcome; worse moral standing happens due to a negative outcome.

- False Consensus: We believe more people agree with us than is actually the case.

- Curse of Knowledge: Once we know something, we assume everyone else knows it, too.

- Spotlight Effect: We overestimate how much people are paying attention to our behavior and appearance.

- Availability Heuristic: We rely on immediate examples that come to mind while making judgments.

- Defensive Attribution: As a witness who secretly fears being vulnerable to a serious mishap, we will blame the victim less if we relate to the victim.

- Just-World Hypothesis: We tend to believe the world is just; therefore, we assume acts of injustice are deserved.

- Naïve Realism: We believe that we observe objective reality and that other people are irrational, uninformed, or biased.

- Naïve Cynicism: We believe that we observe objective reality and that other people have a higher egocentric bias than they actually do in their intentions/actions.

- Forer Effect (aka Barnum Effect): We easily attribute our personalities to vague statements, even if they can apply to a wide range of people.

- Dunning-Kruger Effect: The less you know, the more confident you are. The more you know, the less confident you are.

- Anchoring: We rely heavily on the first piece of information introduced when making decisions.

- Automation Bias: We rely on automated systems, sometimes trusting too much in the automated correction of actually correct decisions.

- Google Effect (aka Digital Amnesia): We tend to forget information that’s easily looked up in search engines.

- Reactance: We do the opposite of what we’re told, especially when we perceive threats to personal freedoms.

- Confirmation Bias: We tend to find and remember information that confirms our perceptions.

- Backfire Effect: Disproving evidence sometimes has the unwarranted effect of confirming our beliefs.

- Third-Person Effect: We believe that others are more affected by mass media consumption than we ourselves are.

- Belief Bias: We judge an argument’s strength not by how strongly it supports the conclusion but how plausible the conclusion is in our own minds.

- Availability Cascade: Tied to our need for social acceptance, collective beliefs gain more plausibility through public repetition.

- Declinism: We tent to romanticize the past and view the future negatively, believing that societies/institutions are by and large in decline.

- Status Quo Bias: We tend to prefer things to stay the same; changes from the baseline are considered to be a loss.

- Sunk Cost Fallacy (aka Escalation of Commitment): We invest more in things that have cost us something rather than altering our investments, even if we face negative outcomes.

- Gambler’s Fallacy: We think future possibilities are affected by past events.

- Zero-Risk Bias: We prefer to reduce small risks to zero, even if we can reduce more risk overall with another option.

- Framing Effect: We often draw different conclusions from the same information depending on how it’s presented.

- Stereotyping: We adopt generalized beliefs that members of a group will have certain characteristics, despite not having information about the individual.

- Outgroup Homogeneity Bias: We perceive out-group members as homogeneous and our own in-groups as more diverse.

- Authority Bias: We trust and are more often influenced by the opinions of authority figures.

- Placebo Effect: If we believe a treatment will work, it often will have a small physiological effect.

- Survivorship Bias: We tend to focus on those things that survived a process and overlook ones that failed.

- Tachypsychia: Our perceptions of time shift depending on trauma, drug use, and physical exertion.

- Law of Triviality (aka “Bike-Shedding”): We give disproportionate weight to trivial issues, often while avoiding more complex issues.

- Zeigarnik Effect: We remember incomplete tasks more than completed ones.

- IKEA Effect: We place higher value on things we partially created ourselves.

- Ben Franklin Effect: We like doing favors; we are more likely to do another favor for someone if we’ve already done a favor for them than if we had received a favor from that person.

- Bystander Effect: The more other people are around, the less likely we are to help a victim.

- Suggestibility: We, especially children, sometimes mistake ideas suggested by a questioner for memories.

- False Memory: We mistake imagination for real memories.

- Cryptomnesia: We mistake real memories for imagination.

- Clustering Illusion: We find patterns and “clusters” in random data.

- Pessimism Bias: We sometimes overestimate the likelihood of bad outcomes.

- Optimism Bias: We sometimes are over-optimistic about good outcomes.

- Blind Spot Bias: We don’t think we have bias, and we see it others more than ourselves.